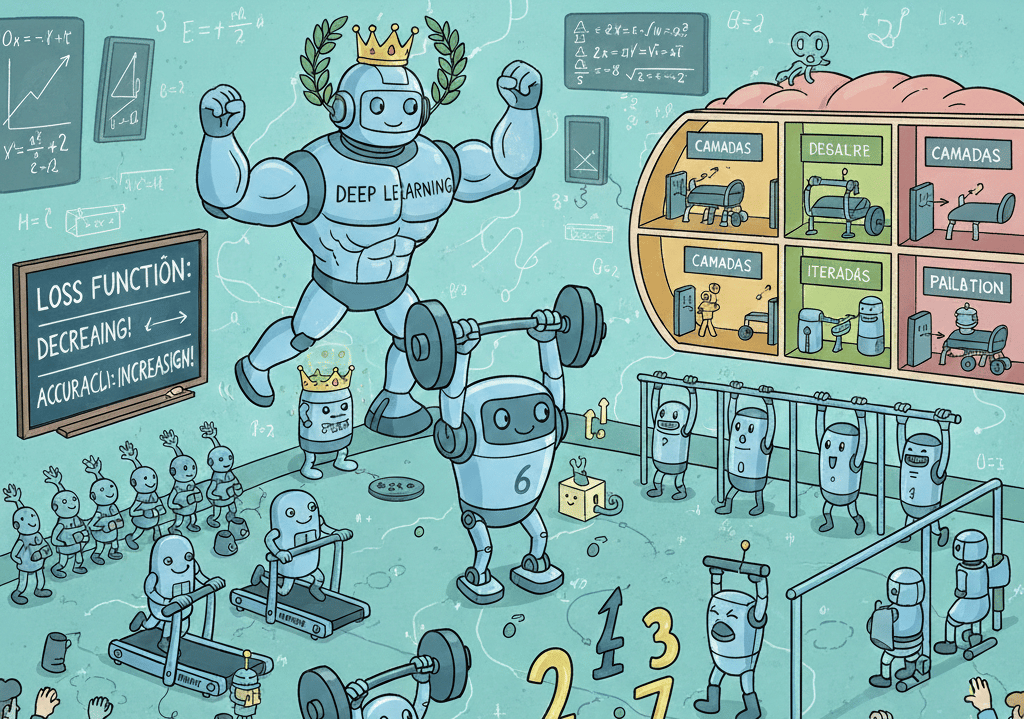

Como a IA Aprende: O Ginásio Matemático da Máquina

CURIOSIDADES

Se dermos uma rede neural a um computador, ela começa como uma tábua rasa, ou pior, como um gerador de ruído aleatório. O processo de transformar esse ruído em inteligência é o que chamamos de "Treino". É aqui que a matemática se transforma em intuição digital, e o processo é mais parecido com o treino de um atleta do que com a instalação de um software.

O treino baseia-se num ciclo constante de três passos: Previsão, Erro e Correção. Imagine que estamos a treinar uma IA para prever o preço de uma casa. Nós damos-lhe os dados (tamanho, localização, número de quartos) e a IA faz uma estimativa. Digamos que ela diz 100 mil euros, mas o preço real é 150 mil.

O segundo passo é o cálculo da "Função de Perda" (Loss Function). Esta função mede quão errada a IA está. No nosso exemplo, o erro é de 50 mil euros. O objetivo do treino é reduzir este valor de erro para o mínimo possível através de milhares ou milhões de exemplos. A função de perda é o "professor" que diz à rede: "Estás longe do alvo, tenta outra vez".

O terceiro passo é a "Otimização". Aqui entra um algoritmo chamado Descida de Gradiente. Imagine que a IA está no topo de uma montanha nebulosa (erro alto) e quer chegar ao vale (erro baixo). Ela não consegue ver o caminho todo, mas consegue sentir a inclinação do terreno debaixo dos seus pés. Ela dá um pequeno passo na direção da descida mais íngreme.

Na rede neural, este "passo" significa ajustar ligeiramente os biliões de pesos e vieses que mencionámos anteriormente. Se a IA errou para baixo no preço da casa, ela aumenta o peso de características como "localização premium". Ela faz este ajuste para todos os neurónios ao mesmo tempo, usando uma técnica matemática chamada cálculo diferencial.

Para um leigo, treinar uma IA é como afinar um instrumento musical com biliões de cordas. Toca-se uma nota (entrada), ouve-se o som (saída) e, se estiver desafinado (erro), apertam-se ou desapertam-se as cordas (ajuste de pesos). Repete-se isto até que o som seja perfeito. A diferença é que a IA faz isto à velocidade da luz.

Um conceito crucial é o "Overfitting" (sobreajuste). Imagine um aluno que decora as respostas do exame em vez de aprender a matéria. Se dermos sempre os mesmos dados à IA, ela pode decorar esses exemplos específicos perfeitamente, mas falhar miseravelmente quando encontrar algo novo. O desafio dos engenheiros é garantir que a IA "generaliza", ou seja, aprende a lógica por trás dos dados.

Os dados são o combustível deste processo. Sem biliões de exemplos de alta qualidade, a rede neural nunca sairá do estado de "bebé". É por isso que empresas como a Google ou a Meta têm tanta vantagem: elas possuem as maiores bases de dados do mundo para alimentar o treino das suas redes.

O treino de grandes modelos, como o que alimenta o ChatGPT, consome quantidades massivas de energia e requer supercomputadores com milhares de chips a trabalhar em uníssono. É um esforço de engenharia que combina física, matemática avançada e uma infraestrutura elétrica comparável à de uma pequena cidade.

Quando o treino termina, temos o que chamamos de "Modelo". O modelo é apenas um ficheiro com os biliões de pesos finais anotados. Este ficheiro pode ser copiado e distribuído. Quando o usamos no nosso telemóvel, a IA já não está a aprender; está apenas a usar o que aprendeu (um processo chamado Inferência) para nos dar respostas instantâneas.

O treino é, em última análise, a transformação de dados em conhecimento estatístico. É o momento em que a máquina deixa de ser apenas metal e código para se tornar um sistema capaz de antecipar a realidade com uma precisão que, muitas vezes, ultrapassa a humana.